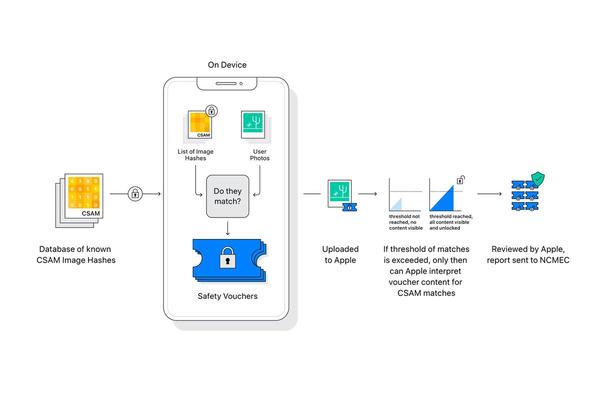

Apple a annoncé jeudi de nouvelles fonctionnalités qui numériseront les photos des utilisateurs d'iPhone et d'iPad pour détecter et signaler de grandes collections d'images d'abus sexuels sur des enfants stockées sur ses serveurs cloud.

"Nous voulons aider à protéger les enfants des prédateurs qui utilisent des outils de communication pour les recruter et les exploiter, et limiter la propagation du matériel pédopornographique (CSAM)", a déclaré Apple dans un communiqué.

"Ce programme est ambitieux et la protection des enfants est une responsabilité importante", a-t-il déclaré. "Nos efforts vont évoluer et s'étendre au fil du temps."

Apple a déclaré que le travail de détection se déroule sur l'appareil et a insisté sur le fait que seules les personnes qui ont de grandes collections d'images téléchargées sur iCloud qui correspondent à une base de données de matériel d'abus sexuel d'enfants connus franchiraient un seuil qui permettrait à certaines de leurs photos d'être décryptées et analysées par Apple. .

Notant que posséder CSAM "est un acte illégal", Erik Neuenschwander, responsable de la protection de la vie privée d'Apple, a déclaré jeudi lors d'un appel aux médias que "le système a été conçu et formé" pour détecter les images de la base de données CSAM du National Center for Missing & Exploited Children's.

Neuenschwander a déclaré que les personnes dont les images sont signalées aux forces de l'ordre ne seraient pas informées et que leurs comptes seraient désactivés.

"Le fait que votre compte soit désactivé est un acte notable pour vous", a déclaré Neuenschwander.

Apple a déclaré que sa suite de systèmes d'exploitation pour appareils mobiles serait mise à jour avec la nouvelle fonction de sécurité pour les enfants "plus tard cette année".

John Clark, président et chef de la direction du National Center for Missing & Exploited Children, a déclaré : « La protection étendue d'Apple pour les enfants change la donne. Avec autant de personnes utilisant des produits Apple, ces nouvelles mesures de sécurité ont un potentiel de sauvetage pour les enfants qui sont attirés en ligne et dont les images horribles circulent dans du matériel pédopornographique. »

Certains experts en protection de la vie privée ont exprimé leur inquiétude.

"Il y a quelques problèmes avec ces systèmes", a déclaré Matthew D. Green, professeur agrégé de cryptographie à l'Université John Hopkins. « La première est que vous devez faire confiance à Apple, car ils ne recherchent que du contenu légitimement mauvais. Si le FBI ou le gouvernement chinois s'appuient sur Apple et leur demandent d'ajouter des images spécifiques à leur base de données, il n'y aura aucun moyen pour vous (l'utilisateur) de le détecter. Vous serez simplement signalé pour avoir ces photos. En fait, la conception du système rend presque impossible de savoir ce qu'il y a dans cette base de données si vous ne faites pas confiance à Apple.

Dans le cadre de la mise à jour, l'application Messages d'Apple utilisera également « l'apprentissage automatique sur l'appareil pour analyser les images jointes et déterminer si une photo est sexuellement explicite » pour les mineurs dont les appareils utilisent des fonctionnalités de contrôle parental.

L'application Messages interviendra si l'ordinateur pense que le mineur peut envoyer ou recevoir une image ou une vidéo montrant "les parties du corps privées que vous couvrez avec des maillots de bain", selon les diapositives fournies par Apple.

L'application Messages ajoutera des outils pour avertir les enfants et leurs parents lorsque des photos sexuellement explicites sont reçues ou envoyées.

Pomme

"Lorsqu'un enfant reçoit ce type de contenu, la photo sera floue et l'enfant sera averti, présenté des ressources utiles et rassuré qu'il n'y a pas de problème s'il ne veut pas voir cette photo", a déclaré Apple dans un communiqué de presse.

Des captures d'écran informatives montrent un iPhone empêchant les enfants d'envoyer des images sensibles avec un avertissement indiquant que « des photos et des vidéos sensibles peuvent être utilisées pour vous blesser » et avertissant que « la personne concernée pourrait ne pas vouloir qu'elles soient vues ».

"Par mesure de précaution supplémentaire, l'enfant peut également être informé que, pour s'assurer qu'il est en sécurité, ses parents recevront un message s'ils le voient. Des protections similaires sont disponibles si un enfant tente d'envoyer des photos sexuellement explicites. L'enfant sera averti avant l'envoi de la photo et les parents peuvent recevoir un message si l'enfant choisit de l'envoyer."