Plus tôt cette année, j'ai examiné un rapport sur l'éthique de l'IA, publié par le Forum économique mondial, rédigé principalement par des employés de Deloitte, que j'ai rejeté comme inutile. Mais le rapport actuel de Deloitte, bien au contraire, était bien écrit et plein de bons conseils au lieu des platitudes habituelles (voir Beyond Good Intentions: Navigating the Ethical Dilemmas Facing the Technology Industry, publié par Deloitte).

J'ai eu la chance de discuter de l'article avec l'auteur principal, Paul Silverglate. Voici mon examen du papier, avec cette conversation à l'esprit.

Le rapport commence par un ensemble clair d'objectifs :

C'est une proposition ambitieuse pour un rapport. L'une des premières affirmations du rapport était:

C'est une déclaration audacieuse. S'il est vrai que la technologie, en particulier l'IA, n'a pas créé de méthodes quantitatives de biais et de discrimination, beaucoup n'ont même pas commencé à aborder le problème. Les médias sociaux sont les principaux coupables. Les courtiers en données doivent également faire face à des réglementations plus strictes. Mais il existe d'autres exemples insidieux tels que les jeux vidéo, les études de marché et les podcasts.

Le document propose cinq dilemmes :

Concernant l'utilisation des données, le rapport de Deloitte dénonce les violations de données et les transgressions avec les données des consommateurs :

Les normes universelles sont peu probables. Aux États-Unis, la protection des personnes du secteur privé n'a pratiquement aucune valeur juridique, à quelques exceptions notables près. Parce que les États-Unis sont un pays de plus de 50 juridictions, les normes pour les données vont de strictes à inexistantes. À l'échelle internationale, il existe déjà des refuges pour les courtiers en données peu scrupuleux qui hébergent leurs données avec peu ou pas de contrôle.

Il semble également y avoir un indice dans le commentaire ci-dessus que les entreprises technologiques souhaitent respecter. Pour chaque Apple ou Microsoft, des milliers d'entreprises technologiques n'agiront que si elles y sont contraintes. Le logiciel de reconnaissance faciale de Microsoft et l'apprentissage fédéré d'Apple posent également des problèmes.

Concernant la durabilité de l'environnement, les auteurs soulèvent les questions suivantes : "La consommation d'énergie, les chaînes d'approvisionnement qui pourraient être plus efficaces, les déchets de fabrication et la consommation d'eau dans la fabrication des semi-conducteurs." Les supercalculateurs actuels nécessitent 40 à 50 MW pour fonctionner, suffisamment pour faire fonctionner une petite ville. Combien de combustible fossile faut-il pour générer et transmettre autant d'énergie 24 heures sur 24 ?

Pour moi, le problème de durabilité le plus important est l'approvisionnement en matériaux de terres rares utilisés comme composants dans les appareils de haute technologie, y compris les smartphones, les appareils photo numériques, les disques durs d'ordinateur, les lampes fluorescentes et à diodes électroluminescentes (DEL), les téléviseurs à écran plat, les ordinateurs moniteurs et écrans électroniques. De grandes quantités de certaines terres arrière sont également utilisées dans les technologies d'énergie propre et de défense. Actuellement, la Chine contrôle 87 % du marché et de graves inquiétudes ont été soulevées quant à la toxicité de la production.

Sur les menaces à la vérité, les auteurs mettent en garde :

L'affirmation est indéniable. Mon prochain article pour diginomica sur l'IA et la désinformation approfondira davantage. Sur la difficile question de l'explicabilité de l'IA, les auteurs écrivent :

L'explicabilité est un terme à la mode, mais il n'est pas utile. Ce dont les développeurs d'algorithmes ont besoin, c'est de comprendre le modèle. L'explicabilité ne fournit que ce que le modèle fait dans les termes du modèle.

La catégorie "Trustworthy AI" me pose quelques problèmes. Digne de confiance n'est pas nécessairement éthique. La confiance est basée sur la transparence, la réputation et parfois, malheureusement, une confiance aveugle en des personnages totalement indignes de confiance. Ce n'est pas un bien consommé. Placer la confiance au centre implique que l'éthique est une préoccupation secondaire.

Un exemple frappant d'éthique mais pas digne de confiance est l'utilisation de l'apprentissage automatique en radiologie. Après quelques gaffes au début lorsque le modèle de radio-oncologie de Stanford Medical a produit des résultats notables entre différents groupes ethniques, ils sont retournés à la planche à dessin. Ils ont développé un système qui identifiait les tumeurs que la plupart d'un panel de radiologues n'avaient pas, et le degré de faux positifs et négatifs était uniformément réparti entre les groupes. Ils avaient développé un système éthique, débarrassé de tout préjugé, mais la confiance était un autre problème.

La confiance concerne ce à quoi ou à qui faire confiance ou comment créer la confiance, que ce soit éthique ou non. Bien qu'ils soient mélangés de manière spécifique, poursuivre la confiance à l'exclusion de l'éthique est dangereux.

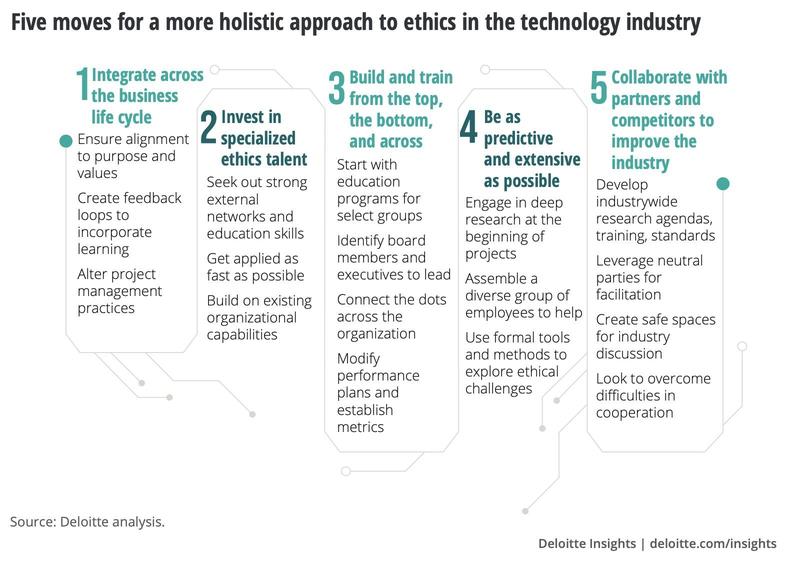

"Cinq mesures clés pour aider à renforcer la clarté et la capacité"

Au lieu de simplement énoncer les problèmes, le document poursuit en suggérant quelques solutions.

Voici mon avis sur chacun :

Mon avis : ho-hum.

Mon avis : Aucune de ces choses ne nécessite de profondes manipulations psychologiques de la part de la direction. Et tout le récit me donne un sentiment effrayant qui implique une approche paternaliste - ceux au-dessus de vous s'engagent dans des activités pour vous rendre éthique. Je pense que c'est l'inverse. Je sais cela. Ce type de réflexion est endémique chez les consultants "stratégie" qui ne voient que la perspective C-suite.

Mon avis: Cela semble impliquer les tentatives précédemment tentées et seulement légèrement réussies pour éduquer l'ensemble de l'organisation à l'éthique. Rien ne prouve que cela ait l'effet escompté. Plus qu'un cours sur la pensée déontologique par rapport à la pensée conséquentielle, les gens ont besoin d'un sens organisationnel de la façon dont ces idées s'appliquent à leur travail. N'oubliez pas que l'éthique est discursive. Ce ne sont pas des règles.

Mon avis : Ces suggestions ne sont pas susceptibles d'être initiées dans les organisations, du moins pas pour très longtemps.

Mon avis : Ce sont des organisations compétitives et secrètes. Toute collaboration serait superficielle.

Ma prise

Il y a beaucoup de conseils utiles dans ce document, même si je ne suis pas d'accord avec certains d'entre eux, comme indiqué. J'ai apprécié mon cameration avec Silverglate, qui était ouvert à certains donnant-donnant et bien informé sur le sujet.