Използвайки техники за генериране на състезателни изображения, ние се борим с някои от най-новите модели на компютърно зрение, които нападателите използват. Използваме тази техника, за да победим успешно моделите за машинно обучение на нападателите, като същевременно поддържаме необходимите промени в пикселите до минимум, за да не повлияем на доброто потребителско изживяване. Прочетете, за да видите как работи.

Компютърното зрение дава на машините усещане за зрение. Благодарение на напредъка в областта на изкуствения интелект, компютърното зрение се разви с главоломна скорост през последните години. Технологията, която направи възможни автономните превозни средства, също се използва широко от измамници за автоматично индексиране и класифициране на изображения и за побеждаване на системи за уеб сигурност, които включват визуално предизвикателство, изискващо взаимодействие с потребителя.

Манипулиране на ML моделите на нападателите

За защита срещу усъвършенствани атаки, управлявани от машинно обучение, срещу предизвикателствата на Arkose Labs за прилагане, ние въведохме нова техника за генериране на изображения, наречена Adversarial Image Поколение. Ние използваме тази техника, за да се защитим срещу някои от най-новите модели на компютърно зрение, които атакуващите използват. Използвайки ефективни смущения, тази техника успешно побеждава моделите за машинно обучение на нападателите, като същевременно поддържа необходимите промени в пикселите до минимум.

В Arkose Labs сме свидетели на безброй атаки. За да се защитим от такова голямо разнообразие от атаки, ние генерираме няколко комплекта изображения за всеки пъзел. Всеки набор от изображения има уникални настройки, като различни фонове, стилове или инструкции. Тези различни настройки помагат на нападателите да заблудят с различно разпределение на пикселите в изображенията и различни резултати.

Въпреки това, алгоритмите за машинно обучение са добри в предвиждането на данни, които никога не са виждали преди. В резултат на това текущият метод за генериране на изображения може да не работи винаги според очакванията. Затова разработихме нов метод за генериране на изображения, който добавя неприятно смущение към изображенията, за да манипулира разпознаването на изображения от нападателите. Скорошни изследвания показаха, че е лесно да заблудите моделите за дълбоко обучение с известен шум върху изображенията.

.

Фиг.1. Състезателно смущение (Справка: https://arxiv.org/pdf/1906.00204.pdf)

Първоначално моделът може да идентифицира правилно изображението. Добавянето на противников шум към изображенията напълно заблуждава модела. Моделът за машинно обучение може правилно да идентифицира оригиналното изображение като снимка на полярна мечка, но се заблуди да го види като съдомиялна машина след добавянето на шума.

За да изчислим състезателното смущение, можем да използваме метод, базиран на бърз градиент, и метод, базиран на оптимизация, с подход на ансамбъл. Различни проучвания в тази област показват, че е възможно да се прехвърли смущението, генерирано от подхода на ансамбъла, между различни модели на компютърно зрение. Този метод се използва за състезателни изображения за защита срещу различни атаки с машинно обучение.

Фиг.2. Съпернически процес на смущение

Генерирането на състезателно изображение се провежда като цикъл. Първата стъпка е да генерирате противопоставящи се изображения. Втората стъпка е да обучите обучените модели с противоположни изображения. Тъй като нападателите могат да се обучават на противопоставящи се изображения, потокът ще продължи да генерира противопоставящи се изображения с моделите, обучени специално на противопоставящи се изображения преди. По този начин потокът може да зададе шума по-висок и по-силен при всяка итерация.

Казус от „Пъзела с ръце“

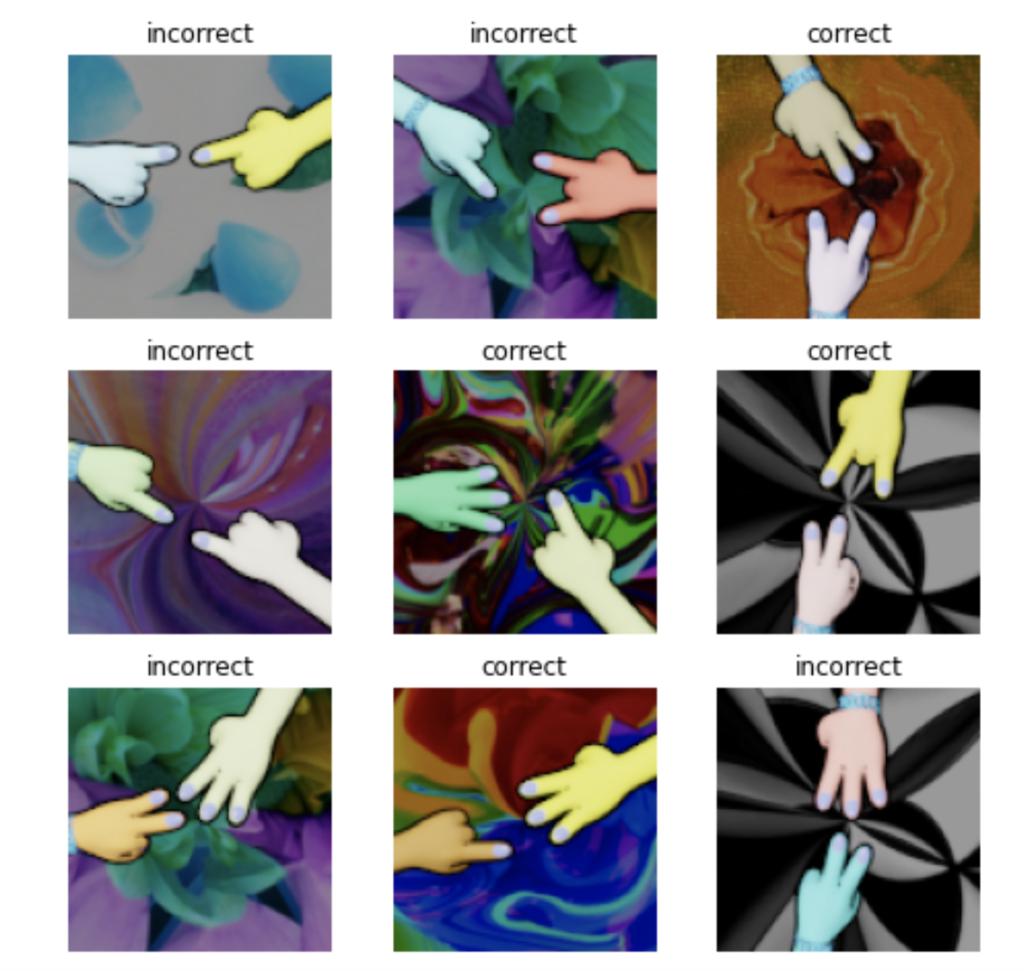

За да демонстрираме отбранителните и тренировъчните сили на противников образ, нека разгледаме казус, описан по-долу. Този казус е ръчен пъзел, както е показано на фиг.3. Правилните изображения са тези с общо четири пръста, останалите са неправилни.

Методът на състезателно смущение помага да се създаде едно от правилните изображения, както е показано на Фиг.4 по-долу. Човек може да не забележи разликата между двете снимки, с изключение на леко обезцветяване в долната дясна ръка на второто изображение. Моделът за машинно обучение обаче няма да може да разпознае изображението и да го класифицира като неправилно.

Фиг.3. Визуализация на данни на ръчен пъзел

Първото изображение на фигура 4 по-горе е оригиналното изображение (правилно). Второто изображение е противниковото изображение (неправилно). Третото изображение показва разликата между оригиналното и противниковото изображение. Последното изображение е увеличената разлика на третото изображение.

Отбранителна сила

Ние тестваме изображенията с най-модерните модели за машинно обучение. Ние обучаваме тези модели вътрешно с добра точност. Резултатите са показани на фиг.5. Точността на играта за състезателната кофа намаля до около 3% в сравнение с 8% за стария комплект изображения.

Фиг.5. Точност на играта на стара и съперническа кофа срещу атака с машинно обучение

Сила на обучението

Като се има предвид технологичното им умение, нападателите все още са в състояние да събират конкурентни изображения и да обучават модели за машинно обучение върху тези изображения. Незначителна промяна на пикселите в противниковите кофи може да улесни обучението за нападателите, което може да е причина за безпокойство. Фигура 6 показва, че дори при незначителна промяна на пикселите, моделите все още трябва да научат отново противопоставящите се изображения.

Фиг.6. Крива на размера на извадката на нова и съперническа кофа за обучение по машинно обучение

В ситуация, в която нападателите могат да тренират на противникови изображения, потокът може да продължи да добавя шум върху противниковите изображения със същите защитни и тренировъчни сили, както е описано по-горе.

Победете автоматизираните CAPTCHA с Adversarial Perturbation

Тук, в Arkose Labs, ние непрекъснато правим иновации, за да дадем възможност на нашите клиенти да изпреварват развиващите се тактики за атака. Използвайки състезателно смущение, ние им помагаме да победят автоматизираните CAPTCHA програми и да защитим бизнеса и потребителите си от автоматизирани бот атаки. За да научите как правим това, моля, резервирайте демонстрация сега.

*** Това е синдикиран блог на Security Bloggers Network от Arkose Labs, чийто автор е ChunLiang Wu. Прочетете оригиналната публикация на: https://www.arkoselabs.com/blog/adversarial-perturbation-to-defeat-automated-captcha-solvers/